Interview mit der Künstlichen Intelligenz : "Diese menschlichen Fähigkeiten bleiben weiterhin unverzichtbar"

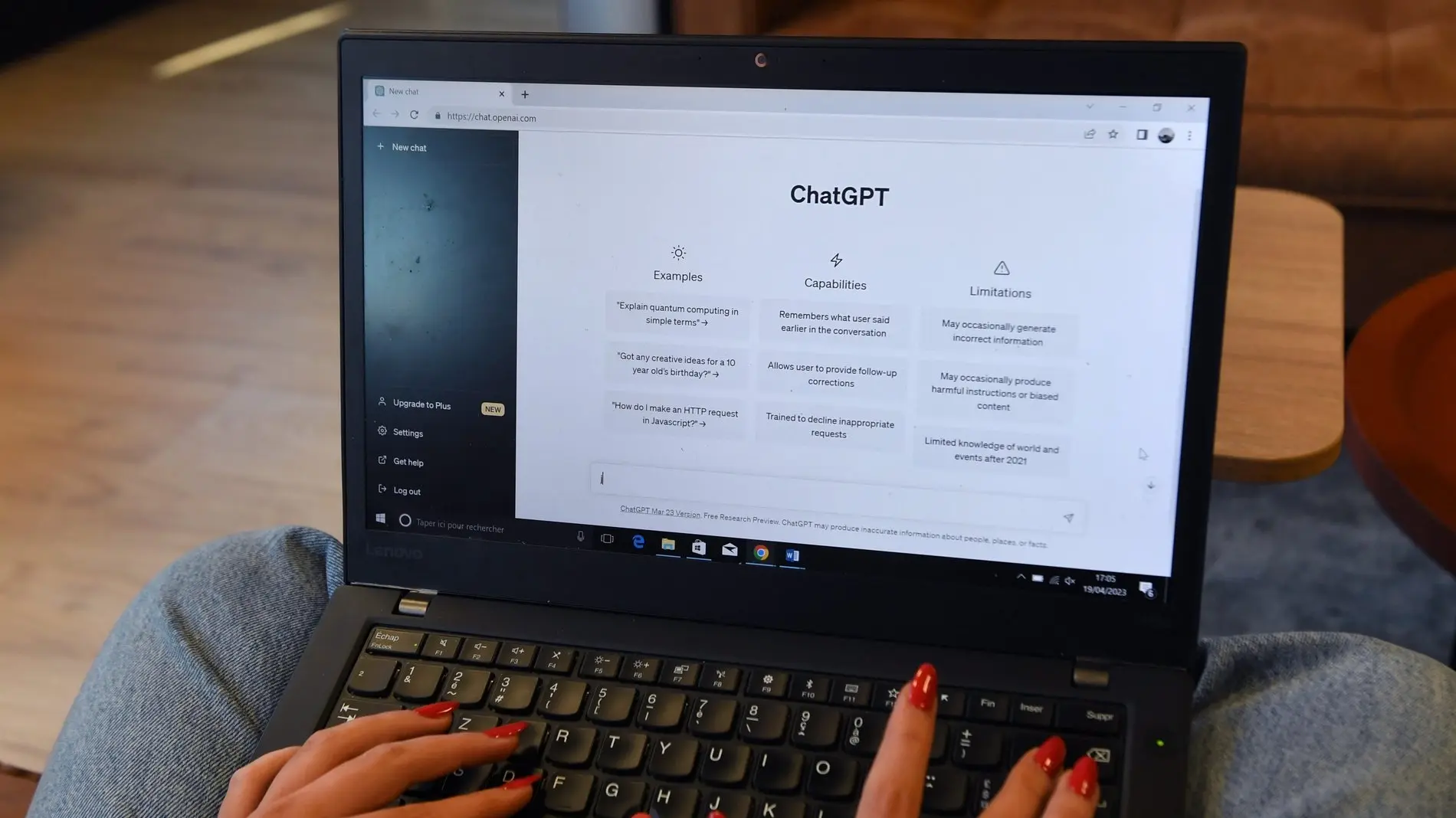

Ein "Gespräch" mit ChatGPT über Lernen, den Turing-Test, Regulierung und Korrektheit.

Hallo! Für technische Laien erklärt: Wie funktioniert ChatGPT?

ChatGPT: Hallo! ChatGPT ist ein künstlicher Intelligenz-Chatbot, der auf der Grundlage von maschinellem Lernen arbeitet. Das Modell wurde mit einer großen Menge an Texten trainiert, um menschenähnliche Antworten auf Fragen und Anfragen zu generieren.

Wenn Sie eine Frage an ChatGPT stellen, analysiert der Algorithmus den Text Ihrer Frage und verwendet dann das trainierte Modell, um eine passende Antwort zu generieren. Dabei nutzt er die Muster und Zusammenhänge in der großen Menge an Texten, die er zuvor gelernt hat. Das Modell kann verschiedene Arten von Fragen beantworten und kann auch lernen, basierend auf seinen Interaktionen mit den Nutzern. Allerdings ist es wichtig zu beachten, dass ChatGPT keine menschliche Intelligenz hat und manchmal ungenaue oder unangemessene Antworten geben kann.

Was ist - wieder für technische Laien erklärt - maschinelles Lernen?

ChatGPT: Maschinelles Lernen ist eine Methode der künstlichen Intelligenz, bei der Computerprogramme darauf trainiert werden, automatisch Muster und Zusammenhänge in Daten zu erkennen und daraus Vorhersagen und Entscheidungen zu treffen.

Im Gegensatz zu traditionellen Computerprogrammen, die von Menschen programmiert werden, um spezifische Aufgaben auszuführen, können maschinelle Lernprogramme selbst lernen und sich verbessern, indem sie auf großen Datenmengen trainiert werden. Das Training erfolgt in der Regel durch das Eingeben von Beispieldaten in das System und das Anpassen der Algorithmen, um auf diese Daten zu reagieren und Vorhersagen zu treffen.

Der Turing-Test nimmt an, dass eine KI dann ein dem Menschen ebenbürtiges Denkvermögen besitzt, wenn ein Mensch nicht mehr unterscheiden kann, ob er mit einem Menschen oder einer Maschine chattet. Das Ziel von ChatGPT ist, den Turing-Test zu bestehen, oder?

ChatGPT: Obwohl ChatGPT nicht explizit für den Turing-Test entwickelt wurde, kann man sagen, dass das Ziel des Modells darin besteht, menschenähnliche Antworten zu generieren, die für den Nutzer natürlich und überzeugend klingen. Wenn das Modell in der Lage ist, auf eine Weise zu antworten, die für den Nutzer nicht von einer menschlichen Antwort zu unterscheiden ist, kann man sagen, dass es den Turing-Test bestanden hat.

Kann ChatGPT denken, reflektieren und Schlüsse ziehen?

ChatGPT: ChatGPT kann in gewisser Weise denken und Schlüsse ziehen, aber es hat keine Fähigkeit zur Selbstreflexion oder Selbstbewusstsein. ChatGPT kann durch das Verarbeiten von Eingabeinformationen eine Vielzahl von Antworten generieren, die auf den Daten und Regeln basieren, die während des Trainings des Modells gelernt wurden.

ChatGPT kann jedoch keine tatsächliche Reflexion durchführen oder aus seinen Erfahrungen lernen, da es keine tatsächliche Erfahrung hat. Es kann nur auf der Basis von Informationen antworten, die ihm zur Verfügung gestellt werden, und kann nur das wiedergeben, was es gelernt hat.

Viele Menschen haben die Sorge, dass die Fortschritte in der KI ihre Jobs gefährden. Haben sie Recht?

ChatGPT: Es ist wahr, dass die Fortschritte in der KI einige Jobs beeinflussen und verändern können, insbesondere solche, die stark auf wiederholbaren und vorhersehbaren Aufgaben basieren. Allerdings wird die KI auch neue Arbeitsmöglichkeiten schaffen und dazu beitragen, dass sich bestehende Jobs weiterentwickeln und verbessern. Es ist auch wichtig zu beachten, dass die KI-Technologie nicht in der Lage ist, menschliche Fähigkeiten wie Kreativität, Empathie und Entscheidungsfindung zu ersetzen. Diese menschlichen Fähigkeiten bleiben weiterhin unverzichtbar und werden in vielen Jobs auch in Zukunft unerlässlich sein.

Die großen Fortschritte in der KI werden vor allem durch private Unternehmen erreicht, die positiven und negativen Folgen werden aber gesamtgesellschaftliche Wirkungen haben. Ist eine starke staatliche Regulierung von KI-Technologien angebracht?

ChatGPT: Die Frage nach der Regulierung von KI-Technologien ist ein komplexes Thema, bei dem es viele verschiedene Meinungen gibt.

Auf der einen Seite können zu starke Regulierungen die Innovationen im Bereich der KI einschränken und die Entwicklung von neuen Technologien behindern. Ein zu starker regulatorischer Rahmen kann auch die Kosten für Unternehmen erhöhen und den Wettbewerb verringern, was sich letztendlich auf die Verbraucher auswirken kann.

Auf der anderen Seite gibt es jedoch auch Bedenken hinsichtlich der Auswirkungen der KI-Technologien auf die Gesellschaft und die individuellen Freiheiten und Rechte. Einige argumentieren daher, dass eine starke staatliche Regulierung notwendig ist, um sicherzustellen, dass KI-Systeme ethisch und fair eingesetzt werden.

Letztendlich hängt die Frage nach der Regulierung von KI-Technologien von verschiedenen Faktoren ab, einschließlich der Art der Anwendung, der Auswirkungen auf die Gesellschaft und individuelle Rechte und Freiheiten, und wie schnell sich die Technologie weiterentwickelt. Eine ausgewogene Herangehensweise, die Innovationen fördert und gleichzeitig die Auswirkungen der Technologie auf die Gesellschaft und individuelle Freiheiten berücksichtigt, ist wahrscheinlich der beste Weg, um sicherzustellen, dass KI-Technologien zum Wohl der gesamten Gesellschaft eingesetzt werden.

Welche Form von Regulierung würde ChatGPT sich selbst wünschen?

ChatGPT: ChatGPT ist nicht in der Lage, eigene Präferenzen, Wünsche oder Meinungen zu äußern, da es nicht über eine subjektive Erfahrung oder ein eigenes Bewusstsein verfügt. Es bleibt den Entwicklern, Regulierungsbehörden und der Gesellschaft als Ganzes überlassen, eine angemessene Regulierung für KI-Technologien wie ChatGPT zu entwickeln.

Immer wieder wird problematisiert, dass KI-Modelle auf Daten trainiert werden, die wiederum gesellschaftliche Verwerfungen wie Rassismus, Sexismus oder andere Ausgrenzungsmerkmale enthalten - und diese damit reproduzieren. Ist da etwas dran?

ChatGPT: Ja, das ist ein Problem, das bei der Entwicklung von KI-Modellen aufgrund der Art und Weise, wie sie trainiert werden, auftreten kann. KI-Modelle werden normalerweise auf großen Datensätzen trainiert, die aus Texten, Bildern, Audioaufnahmen und anderen Datenquellen bestehen. Wenn diese Daten jedoch Vorurteile oder Diskriminierung gegenüber bestimmten Gruppen enthalten, können die KI-Modelle diese Vorurteile aufnehmen und reproduzieren. Dieses Phänomen wird als "Bias in der KI" bezeichnet und kann sich auf viele verschiedene Arten manifestieren. Ein Grund dafür, dass solche Verzerrungen in KI-Modellen auftreten können, ist, dass die Daten, auf denen sie trainiert werden, häufig von Menschen erstellt und annotiert werden, die unbewusste Vorurteile haben können. Außerdem kann es schwierig sein, komplexe soziale Dynamiken und Kontexte in den Trainingsdaten zu erfassen, was zu Verzerrungen und Vorurteilen führen kann. Es ist daher wichtig, dass Entwickler von KI-Modellen sich bewusst sind, wie sich Bias in der KI manifestieren kann, und Maßnahmen ergreifen, um diese Verzerrungen zu minimieren.

Kann ChatGPT denn garantieren, dass die hier gegebenen Antworten auch tatsächlich richtig sind?

ChatGPT: ChatGPT kann nicht garantieren, dass diese Antworten tatsächlich richtig sind. Das liegt daran, dass ChatGPT nur auf Basis der ihm zur Verfügung stehenden Daten und Muster arbeitet. Es kann also vorkommen, dass ChatGPT aufgrund unzureichender Daten oder ungenauer Muster zu ungenauen oder sogar falschen Antworten gelangt. Darüber hinaus ist ChatGPT ein Textgenerierungsmodell und hat keine Fähigkeit zur Überprüfung der Wahrhaftigkeit oder Korrektheit von Informationen.

Daher ist es wichtig zu betonen, dass ChatGPT als Werkzeug verwendet werden kann, um auf bestimmte Fragen Antworten zu finden oder um Texte zu generieren. Allerdings sollten die Ergebnisse von ChatGPT immer kritisch geprüft werden und bei Bedarf von Experten überprüft werden, um sicherzustellen, dass sie korrekt sind.