Trilog zum AI Act startet : Auf dem Weg zum weltweiten Standard

Eine Einigung auf die erste KI-Verordnung, die den Einsatz von Künstlicher Intelligenz gesetzlich regelt, wird in Brüssel bis zum Jahresende erwartet.

Fertig sein muss sie bis spätestens Anfang 2024 - denn im Juni steht die nächste Europawahl an: Über die KI-Verordnung und das Ziel der EU, der weltweit erst Wirtschaftsraum zu werden, der den Einsatz von Künstlicher Intelligenz gesetzlich regelt, wird mittlerweile seit über zwei Jahren debattiert. Nachdem das Europäische Parlament Mitte Juni den Kompromisstext des sogenannten AI Acts billigte, startet mit dem Trilogverfahren nun die entscheidende Phase. Es gebe von allen Seiten großen politischen Willen, das Projekt bis zum Jahresende zum Abschluss zu bringen, berichteten vergangene Woche zwei Vertreter der EU-Kommission dem Digitalausschuss des Bundestages.

Einteilung in verschiedene Risikogruppen geplant

Gelten soll die Verordnung für alle Anbieter von Produkten oder Dienstleistungen auf KI-Basis, die in der EU in Verkehr oder Betrieb genommen werden, sowie für alle Nutzer von KI-Systemen in der EU. Die Anwendungen sollen verschiedenen Risikogruppen zugeordnet werden - von "minimal" und "begrenzt" über "hoch" bis "inakzeptabel". Damit verbunden sind Sicherheits- und Transparenzanforderungen. KI-Systeme, die ein inakzeptables Risiko darstellen, sollen streng verboten werden. Die Abgeordneten des Europaparlaments forderten zuletzt, dass solche Systeme zum Hochrisikobereich zählen, die Gesundheit, Sicherheit und Grundrechte von Menschen gefährden, aber auch Empfehlungssysteme von großen Social Media-Plattformen oder Systeme, die zur Wähler-Beeinflussung eingesetzt werden.

Dissenz zwischen den Mitgliedsstaaten und dem Parlament erwartet

Dass eine umfassende Regulierung nötig sei, sei Konsens, berichteten die Kommissionsvertreter. Unterschiede in den Texten gebe es bei den verbotenen KI-Praktiken: etwa beim Einsatz von KI-Systemen für die vorausschauende Polizeiarbeit oder beim Verbot von biometrischer Gesichtserkennung im öffentlichen Raum in Echtzeit. Dies sei einer der politisch schwierigsten Punkte zwischen Parlament und Rat: Für einzelne Mitgliedsstaaten könne es sehr schwierig sein, ein komplettes Verbot mitzutragen, prognostizierten sie.

Mehr zu Künstlicher Intelligenz lesen

In einer Bremer Schule hat der Chatbot bereits Einzug in den Unterricht gehalten. Die Technologie dürfte Einfluss auf Prüfungen, Hausaufgaben und Co. nehmen. KI-Gesetz: Europäische Union will Schritt halten

Italien setzt ein Zeichen: Die Datenschutzbehörde verbietet dem amerikanischen Start-up OpenAI mit seinem Chatbot Chat GPT vorerst die Verarbeitung von Nutzerdaten.

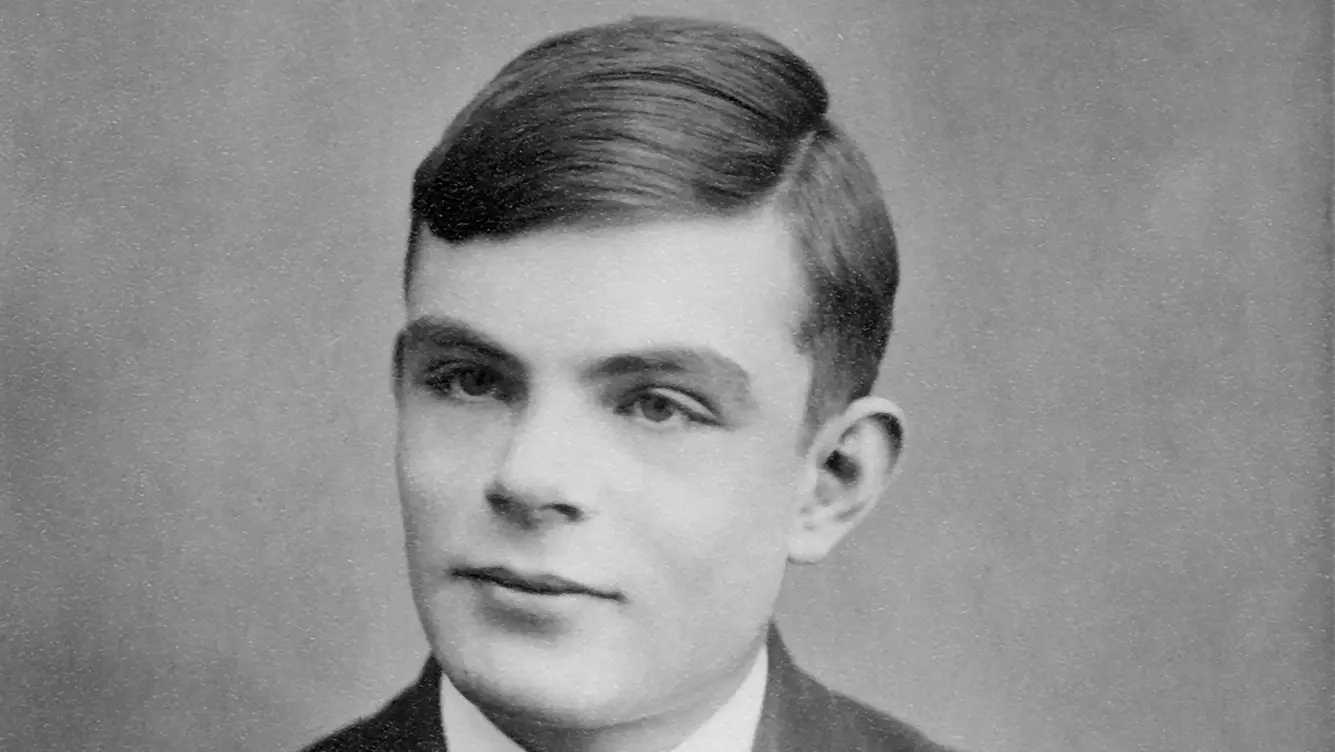

Ein "Gespräch" mit ChatGPT über Lernen, den Turing-Test, Regulierung und Korrektheit.

Offen seien auch Fragen hinsichtlich der Durchsetzung, etwa ob es eine Agentur mit eigener Rechtspersönlichkeit brauche oder ein Expertengremium ohne eigene rechtliche Struktur. Für Diskussionen hatte zuletzt die rasanten Entwicklungen bei generativer Künstlicher Intelligenz gesorgt, wie sie beim Chatbot ChatGPT zum Einsatz kommt. Auf internationaler Ebene habe sich das Klima der Debatte insofern geändert, dass es etwa im G7-Bereich nun klare Aufträge für globale Schutzmaßnahmen und Regeln gebe, berichteten die Vertreter der EU-Kommission. So werde intensiv an einem freiwilligen Verhaltenskodex für große Technologiekonzerne und KI-Entwickler gearbeitet, um die Zeit bis zum Inkrafttreten der Verordnung - voraussichtlich frühestens 2026 - zu überbrücken.