Europas Versuch der Ordnung : Große Hoffnung trifft auf große Unsicherheit

Ob Allzweck-KI oder Spezialanwendung: KI hält im Eiltempo Einzug in Wirtschaft und Gesellschaft. Doch bei den Regeln dafür herrscht derzeit große Unsicherheit.

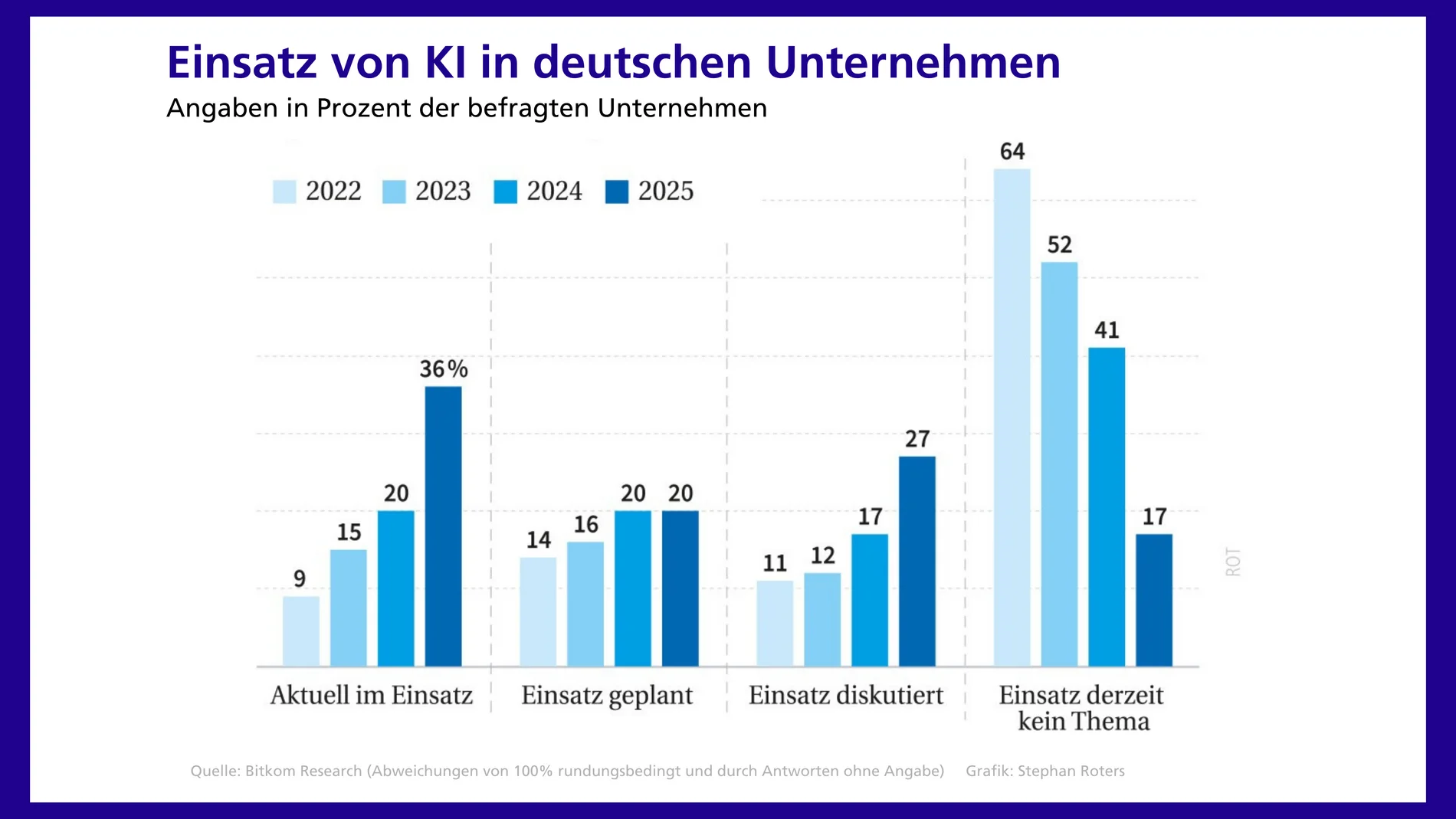

Die deutsche Wirtschaft sieht die Möglichkeiten Künstlicher Intelligenz (KI) als zentrale Herausforderung an. 86 Prozent der Unternehmensführungen sagen laut einer Umfrage des Digitalwirtschaftsverbands Bitkom vom März 2026, dass KI große Bedeutung für sie haben werde. Immerhin 41 Prozent berichten von einem Einsatz, 48 Prozent planen ihn. Der sogenannte "ChatGPT-Schock" 2022 war, auch den Bitkom-Erhebungen zufolge, ein Weckruf: Plötzlich wurde leicht begreiflich, was ein einziges großes Sprachmodell (Large Language Modell, LLM) leisten kann.

Ob und wie KI in Unternehmen, Behörden und anderen Organisationen eingesetzt wird, hängt von vielen Faktoren ab. Ein wichtiger davon ist das Recht. Doch die Rahmenbedingungen beim KI-Einsatz sind verwirrend: Seit August 2024 und August 2025 gelten erste Teile der europäischen Verordnung über Künstliche Intelligenz (KI-Verordnung), auch ohne das deutsche Begleitgesetz. Doch für die zum Inkrafttreten bereits marktverfügbaren Modelle gelten unter der KI-Verordnung teilweise Übergangsfristen. Der 2. August 2026 wäre nun der nächste wichtige Stichtag für alle, die die KI-Verordnung beachten müssen. Dann würde die Regulierung dem verabschiedeten Text des "AI Act" nach eigentlich fast vollständig greifen.

Eine gute Idee, die allerdings große Schwächen offenbart

Anwendungsrelevante Fragen wurden jedoch in Formate wie Ausführungsrechtsakte oder Verhaltenskodizes zur Verordnung ausgelagert oder referenzieren auf technische Normen. Denn die Regulierung sollte das Tempo der technologischen Neuerungen mitgehen können. Der Vorteil dieses Verfahrens ist aber zugleich seine Schwäche: Auch Praktiker sind keineswegs immer schnell. Schon ein Experten-Entwurf für einen "Code of Practice" für generative KI-Modelle wurde mit enormer Verzögerung vorgelegt. Und auch andere relevante Teile für die Umsetzung der KI-Verordnung sind noch nicht fertig.

Zugleich gelten viele ineinandergreifende Vorschriften parallel. Die als horizontale, also sektorenübergreifende Regulierung gedachte Verordnung selbst könnte im Zuge der EU-Omnibus-Gesetzgebung wieder überarbeitet werden, Stichtage verschoben, Regeln geändert werden.

Im Eiltempo zu Lösungen

Das Ziel ist Vereinheitlichung und Vereinfachung. Kommission, Parlament und Mitgliedstaaten haben sich bei der Digitalregulierung verheddert - und versuchen nun, im Eiltempo Lösungen zu finden. Die Verunsicherung ist daher groß: Was gilt nun - und wie lange noch?

„Besonders herausfordernd wird es, wenn innerhalb eines Produkts verschiedene Regulierungen zusammenkommen.“

Die Versicherungswirtschaft ist eine der Branchen, die intensiv mit mathematischen Modellen arbeitet. Von Schadenseintrittswahrscheinlichkeiten hängen etwa Prämienhöhen ab. Die Branche fürchtet, dass übliche Verfahren unter die neuen Vorschriften fallen könnten: "Es ist wichtig, dass schnellstmöglich klargestellt wird, dass traditionelle statistische Verfahren, wie zum Beispiel logistische Regression, keine KI im Sinne der Definition darstellen", sagt ein Sprecher des Gesamtverbands der Deutschen Versicherungswirtschaft (GDV). Und warnt zugleich, dass derzeit Doppelregulierung droht: "Ein Großteil der Vorgaben für Hochrisiko-KI-Systeme wird durch bereits bestehende Regulatorik erfüllt." Es brauche daher unter anderem dringend eine Klärung, welche Regeln Vorrang hätten. Für Finanzdienstleister und Versicherungen stellt sich etwa die Frage: Gelten DORA und Solvency II - oder die KI-Verordnung?

Unternehmen: Normenkollisionen müssen vermieden werden

Die Abgrenzung beschäftigt auch die Maschinen- und Anlagenbauer intensiv. Systeme mit potenziell "hohem Risiko" im Sinne der Verordnung würden einen deutlich größeren Abstimmungsaufwand zwischen IT, Entwicklung und Recht verursachen, schildert Erwin Schuster vom Aalener Werkzeughersteller Mapal Dr. Kress. "Besonders herausfordernd wird es, wenn innerhalb eines Produkts verschiedene Regulierungen zusammenkommen", sagt Schuster. Für seine Branche betrifft das vor allem die Maschinenverordnung und die KI-Verordnung, die unterschiedliche KI-Definitionen verwenden. Aber auch im Zusammenspiel mit den Data Act-Regelungen zur Datennutzunn und dem Cyber Resilience Act für mehr IT-Sicherheit in Produkten sei die Abgrenzung oft schwierig.

"Viele Maschinenbauunternehmen integrieren KI heute direkt in ihre Produkte", erklärt Claus Oetter, Geschäftsführer des Branchenverbands "Verein Deutscher Maschinenbau-Anstalten" (VDMA) für Software und Digitalisierung. Er konstatiert daher: "Wenn für diese Anwendungen mehrere europäische Regelwerke gleichzeitig greifen, muss klar sein, wie sie zusammenspielen.

"Schatten-KI" gilt als besonders großes Risiko

Die Unternehmen beschäftigen sich nun notgedrungen intensiv mit den eingesetzten Technologien. Bewusstsein in den zunehmenden KI-Einsatz zu bringen, gehört zu den ausdrücklichen Zielen der Regulierung. "Transparenz über eingesetzte KI war bislang häufig nur begrenzt vorhanden", schildert Tim Herfurth, Data Scientist bei Zühlke Engineering. "Die KI-Verordnung hat in vielen Unternehmen zunächst zu einer systematischen Bestandsaufnahme von KI-Anwendungen geführt." In vielen Organisationen haben ChatGPT, Copilot oder Gemini, aber auch spezialisiertere Anwendungen längst einen Platz gefunden. Allerdings oft ohne das Wissen der zuständigen Stellen und ohne Berücksichtigung der geltenden Compliance-Vorschriften. Der Einsatz von "Schatten-KI" gilt daher als besonders großes Risiko.

Doch wie kann KI sicher und regelkonform genutzt werden? Künftig soll die Bundesnetzagentur (BNetzA) hier eine Doppelrolle einnehmen: Einerseits soll sie umfassend beraten. Bereits im vergangenen Juli hat die Bonner Behörde den "KI-Service Desk" ins Leben gerufen. Sie solle "eine verlässliche, zentrale Stelle für alle, die Hilfe bei den neuen Regeln der KI-Verordnung benötigen" sein, so BNetzA-Präsident Klaus Müller zum Start. Ein "KI-Compliance-Kompass", der auf der Website der Behörde zur Verfügung steht, bietet erste Orientierung.

Bundesnetzagentur als beratende Aufsichtsbehörde?

Doch die Bundesnetzagentur ist auch als Aufsichtsbehörde vorgesehen. Ein Rollenkonflikt, der auch bei anderen Stellen wie den Datenschutzaufsichtsbehörden mit dem komplexen Datenschutzrecht oder dem Bundesamt für Sicherheit in der Informationstechnik bei den Regeln für die Cybersicherheit kritischer Infrastrukturen immer wieder für Diskussionen sorgt. Was ist beispielsweise, wenn die Behörde etwas empfiehlt, was sich hinterher als rechtswidrig herausstellt?

Der politische Wunsch, dass Behörden als "Enabler", also "Ermöglicher", den Weg durch den Regulierungs-Dschungel aufzeigen, ist älter als die aktuelle Bundesregierung - und der Zielkonflikt vorerst ungelöst. In der Wirtschaft wird die Aufgabenzuweisung durchaus positiv gesehen. "Die Bundesnetzagentur hat die Chance, mehr zu sein als ein Vollzugsorgan", sagt Markus Günther vom Aachener Softwareentwickler Inform. "Wenn sie die Beratungsrolle ernst nimmt, branchenspezifische Auslegungen liefert und den Dialog mit der Industrie sucht, kann sie zum echten Enabler werden." Doch noch fehle die Klarheit, um die Bremse zu lösen.

Der Autor ist freier Journalist in Berlin.

Ob Allzweck-KI oder Spezialanwendung: KI hält im Eiltempo Einzug in Wirtschaft und Gesellschaft. Doch bei den Regeln dafür herrscht derzeit große Unsicherheit.

2025 war in Brüssel das Jahr der Omnibusse. Sie beinhalten Maßnahmen, um den Bürokratieaufwand in der EU zu senken. Doch der Ansatz der Kommission ist umstritten.

Gefälschte Bilder, manipulierte Stimmen: Deep Fakes verbreiten sich rasant und stellen die Gesellschaft vor neue Herausforderungen. Ihre Regulierung bleibt komplex.